Google 今天宣布推出其自家最先进的人工智能模型「Gemini」。Alphabet CEO Sundar Pichai 强调,AI 带来的转变比以往的技术转型更为深远。Gemini作为 Google DeepMind 的一部分,由 Google 各团队联手打造,旨在实现多模态整合,能无缝理解文本、音乐、图像和视频等多种信息类型。

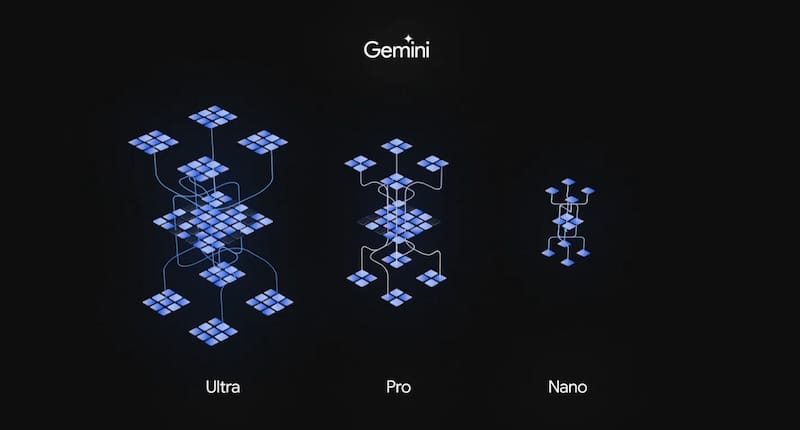

三種模式

Gemini 1.0 推出三种不同模式:Ultra、Pro 和 Nano,各自针对不同任务进行优化。Ultra 在复杂任务中表现卓越,甚至在多项包括大规模多任务语言理解 (MMLU) 在内的基准测试中超越人类专家。它在多模态任务和编码基准测试中也展示了最先进的性能。Pro 和 Nano 则分别针对跨任务扩展和设备上操作进行设计。

全方位感知能力

根据近期的性能测试,Google 的「Gemini」在视觉和听觉互动方面展现出明显优势。这是有意而为之的设计:从一开始,多模态就是 Gemini 计划的核心部分。不同于 OpenAI 分别为图像和语音创建了 DALL-E 和 Whisper,Google 从一开始就建立了一个多感官的综合型号。Google DeepMind CEO Demis Hassabis 表示,他们一直对非常通用的系统感兴趣,尤其关注如何将不同模式结合在一起,从任何数量的输入和感官收集数据,并以同样丰富的方式给出回应。

从文字到多媒体

目前,Gemini 最基础的型号是文字输入和输出,但更强大的型号,如 Gemini Ultra,可以处理图像、视频和音频。Hassabis 透露,这只是开始,Gemini 的通用性将进一步提升,未来还将涉及动作、触感等类似机器人技术的领域。随着时间的推移,他说,Gemini 将获得更多感官,变得更有意识,并在此过程中变得更准确、更扎根于现实。「这些型号将更好地理解周围的世界」。当然,这些型号仍然会产生幻觉,也有偏见和其他问题,但 Hassabis 认为,随着它们获取的信息越来越多,它们的表现会越来越好。

编程领域表现出色

尽管性能测试结果重要,但 Gemini 的真正能力最终将由日常用户在使用它来激发创意、查找信息、编写代码等方面的体验中得到验证。Google 似乎特别看好 Gemini 在编程领域的应用,它使用了一种名为 AlphaCode 2 的新代码生成系统,该系统的表现超过了 85% 的编码竞赛参与者,相较于原始 AlphaCode 的 50% 有显著提升。Pichai 表示,用户将在型号接触的每一个方面注意到改进。