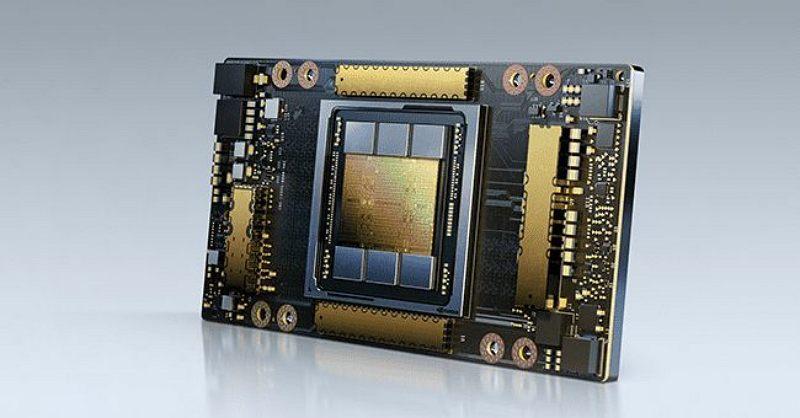

据最新报道,微软自 2019 年起秘密开发自家 AI 芯片,以应对大型语言模型的训练需求,摆脱对 Nvidia 高昂成本的依赖。一些微软和 OpenAI 的员工已经开始试用这些芯片,测试它们在最新大型语言模型,如 GPT-4 中的性能。

Nvidia芯片成本高

目前,Nvidia 是 AI 服务器芯片的主要供应商,许多公司争相购买这些芯片。据估计,OpenAI 在 ChatGPT 的商业化过程中需要超过 30000 个 Nvidia 的 A100 GPU。Nvidia 最新的 H100 GPU 在 eBay 上的售价超过 40000 美元,显示出市场对能有效部署 AI 软件的高性能芯片的需求。

项目名为 Athena

虽然 Nvidia 正努力满足市场需求,但报道称微软正寻求内部解决方案,希望节省 AI 项目的成本。据报道,微软已加快代号「Athena」的 AI 芯片开发项目。虽然尚不清楚微软是否会向 Azure 云客户提供这些芯片,但计划在明年内将 AI 芯片更广泛地应用于微软和 OpenAI。而且微软还对 AI 芯片定好了「路线图」,未来还会有新一代的版本出现。

降低成本非取替 Nvidia

据称,微软自家 AI 芯片并非直接替代 Nvidia 的产品,但内部开发芯片可以大幅降低成本,有助于微软在 Bing、Office 应用、GitHub 等领域持续推出 AI 功能。